Il a beaucoup été question ces derniers temps de considérations morales relativement aux voitures autonomes – je ne parle pas ici des véhicules connectés. En particulier, on s’est beaucoup ému du choix qu’elles seraient amenées à faire entre (prendre le risque de) sacrifier ses occupants ou de (prendre le risque de) renverser et tuer les piétons.

Morale et voitures autonomes

Il ne fait aucun doute que les problématiques incluant un choix moral pour une machine ou une intelligence artificielle (IA) seront au centre de l’attention. Il est intéressant de se poser cette question du choix moral pour des machines et IA alors qu’en pratique, il est quand même rare qu’un humain décide quoi faire lorsqu’il est impliqué dans un accident fatal. C’est encore plus rare lorsque le conducteur est fatigué ou sous l’emprise de l’alcool ou de la drogue.

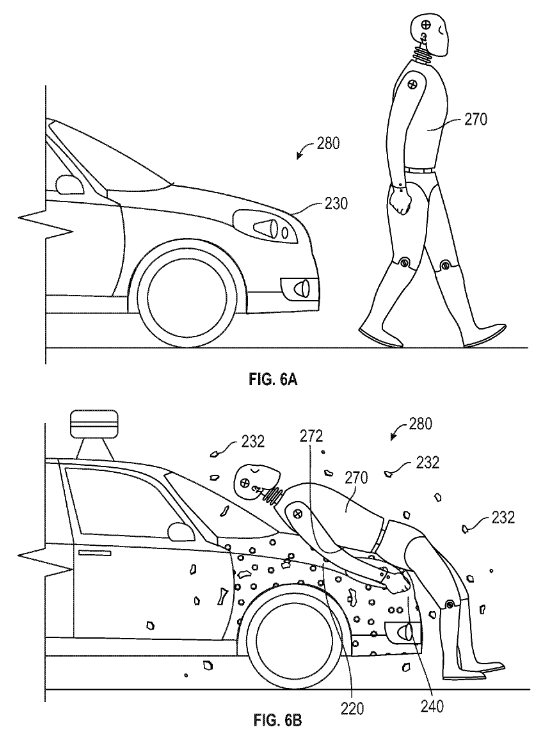

Pourtant, les développeurs cherchent aujourd’hui à limiter le nombre de blessés et de morts qu’une voiture autonome pourrait causer. Google a même été jusqu’à breveter un système qui “collerait” les piétons à la voiture autonome en cas de collision, ce qui permettrait de diminuer les dommages causés au piéton et à la voiture.

]

]

Nul doute que l’on verra d’autres idées être concrétisées dans les prochaines années afin d’améliorer la sécurité de tous aux abords des routes.

Mais ne serait-il pas plus simple de programmer les voitures autonomes pour qu’elles ne blessent pas les humains, plutôt que d’imaginer des choix binaires (oui, je sais, une machine “réfléchit” en 1 et 0) comme celui exposé en introduction ? Ne peut-on pas plutôt programmer les voitures autonomes de sorte qu’elles protègent tant les occupants que les piétons ?

S’il est raisonnable de penser que l’utilisation de voitures autonomes devrait, à terme, faire baisser drastiquement les accidents de la route, je me demande si l’on ne pourrait pas se permettre de laisser de côté, temporairement en tout cas, le côté “moral” des décisions que ces voitures autonomes devraient prendre. Le mieux serait peut-être de ne pas leur faire prendre de telles décisions, en les programmant à protéger les occupants et les piétons, tout en sachant qu’un accident est fatalement inévitable de temps à autre.

Cela me rappelle la première loi de la robotique d’Isaac Asimov :

Un robot ne peut porter atteinte à un être humain ni, en restant passif, permettre qu’un être humain soit exposé au danger.

Police et voitures autonomes

Je me suis aussi demandé comment la police pourrait ou devrait appréhender une voiture autonome. Évidemment, cela ne suppose pas ici qu’elle ait commis une infraction au code de la route, j’imagine qu’elles seront bien programmées pour ne pas infliger d’amendes à leur propriétaire.

Mais si par exemple la police recherche une personne, qu’il convient de faire des contrôles d’identité et qu’il faut pour ce faire demander à une voiture de s’arrêter. Comment faire ?

Un individu sait qu’il doit s’arrêter quand un policier le demande, et comprend qu’une voiture de police qui le suit et qui allume gyrophares et sirène demande qu’il s’arrête. On ne voit donc pas pourquoi il en irait autrement pour une voiture autonome.

Mais que se passe-t-il si l’occupant ne veut pas s’arrêter ou, pour une raison quelconque, ne le peut pas ? Doit-on doter la police de moyens pour passer outre les commandes d’une voiture autonome ? Après tout, elles s’arrêtent déjà aux feux rouges, d’elles-mêmes.

Dans un futur pas si éloigné, les voitures se déplaceront même sans aucun occupant (par exemple un taxi qui retourne à sa place de garage après avoir effectué une course). Comment un policier est-il censé arrêter la voiture ? On pourrait ironiquement penser qu’il n’a qu’à se planter devant le parechoc de la voiture pour qu’elle s’arrête, puisqu’elle est programmée pour éviter les collisions et, espérons-le, protéger les piétons.

On peut imaginer encore le cas d’une voiture autonome inoccupée, mais qui gêne le passage voire, pire, une sortie d’ambulance. Un agent pourrait-il donner l’ordre à la voiture de se déplacer ? L’urgentiste pourrait-il le faire ?

En ce qui concerne les courses poursuites, elles deviendraient probablement inexistantes si l’on venait à doter les forces de l’ordre de moyens de contrôle intrusifs permettant de désactiver ou prendre le contrôle à distance des voitures autonomes. Nul doute que les frénétiques de la sécurité antiterroriste adoreraient…

Tous ces usages potentiels devraient être implémentés suffisamment à l’avance dans le logiciel et le matériel des voitures autonomes. Les voitures autonomes devraient donc être conçues, si c’est ce que l’on souhaite, de manière à gérer des commandes en temps réel provenant de tiers. Cela nécessitera probablement des canaux de communications sécurisés, des systèmes d’authentification et des dispositifs internes qui ressemblent en fin de compte à un kill switch. Quand on sait qu’on a déjà réussi à pirater une voiture sur l’autoroute…

Se pose encore une potentielle question de protection des données. Il est envisageable que les forces de l’ordre puissent aussi avoir accès, à distance, sur demande, à des informations sur la voiture (au moyen de la plaque d’immatriculation, si elle existe encore), mais aussi sur ses occupants. On pourrait aussi imaginer que la police accède à l’historique des déplacements de la voiture, ce qui n’irait pas sans poser de sérieux problèmes juridiques liés aux libertés individuelles comme la liberté de mouvement et le droit à la protection de la sphère privée.

Dans tous les cas, ces problématiques doivent être réfléchies dès aujourd’hui, tant par les ingénieurs que par les politiciens, qui doivent d’ailleurs travailler de concert pour que le cadre réglementaire soit efficace et adéquat, et le moins liberticide.

Il y a urgence, les voitures autonomes sont déjà sur nos routes.